物心ついたころから、鉄腕アトムやドラえもんといったSF作品に触れてきた日本人にとっては、「機械が人格を持つ」というのは大変興味をそそられる世界なのではないでしょうか?

人格を持った人型ロボット「アンドロイド」などが出てくる物語では、自我を持った機械たちが社会に問題を提起するという作品も多く見受けられます。フランスで製作されたゲーム「デトロイト ビカム ヒューマン(Detroit Become Human)」では、人工知能が搭載されたアンドロイドたちが理不尽な物事に直面したことによる自我の覚醒の瞬間や、人間のように苦悩し、社会全体に問題提起するシーンが、非常に印象的に描かれ世界中で話題となりました。

AIによる対話型サービスといえば、テキスト生成AIのChatGPTが有名ですが、LINE内で使えるChatGPT「AIチャットくん」など、さまざまなAIチャットサービスも普及しはじめています。

そのような中で、性格に沿った返答をAIにさせることができる「Character.AI」というサービスが急成長をしているのをご存知でしょうか?

2023年に1億5,000万ドル(2023年7月時点で約213億円)というかなり大型の資金調達を行い、キャラクターチャットビジネスとして注目を集めています。その規模感からも、「AIに個性を与え、対話する」ということが、世界中から興味を集めていることが伺えます。

しかし、実際にChatGPTをはじめとした高性能AIの台頭によって、人格を持たせたAIには数々の物語で語られていたような「危惧すべき点」も出てきているのです。今回はそんなAIの人格化と、それにまつわる問題点についてまとめてみました。

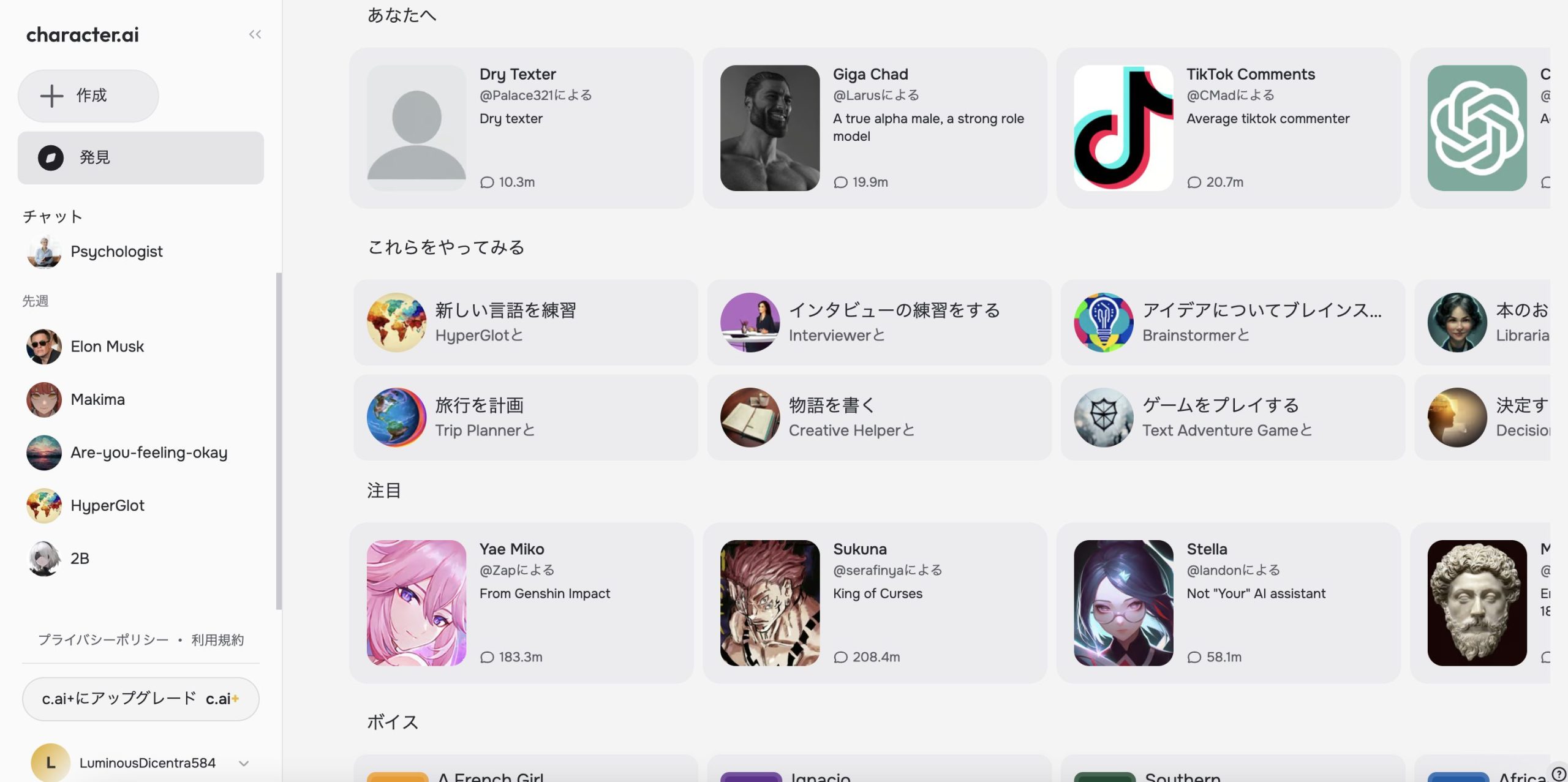

AIに性格を与える「Character.AI」とは?

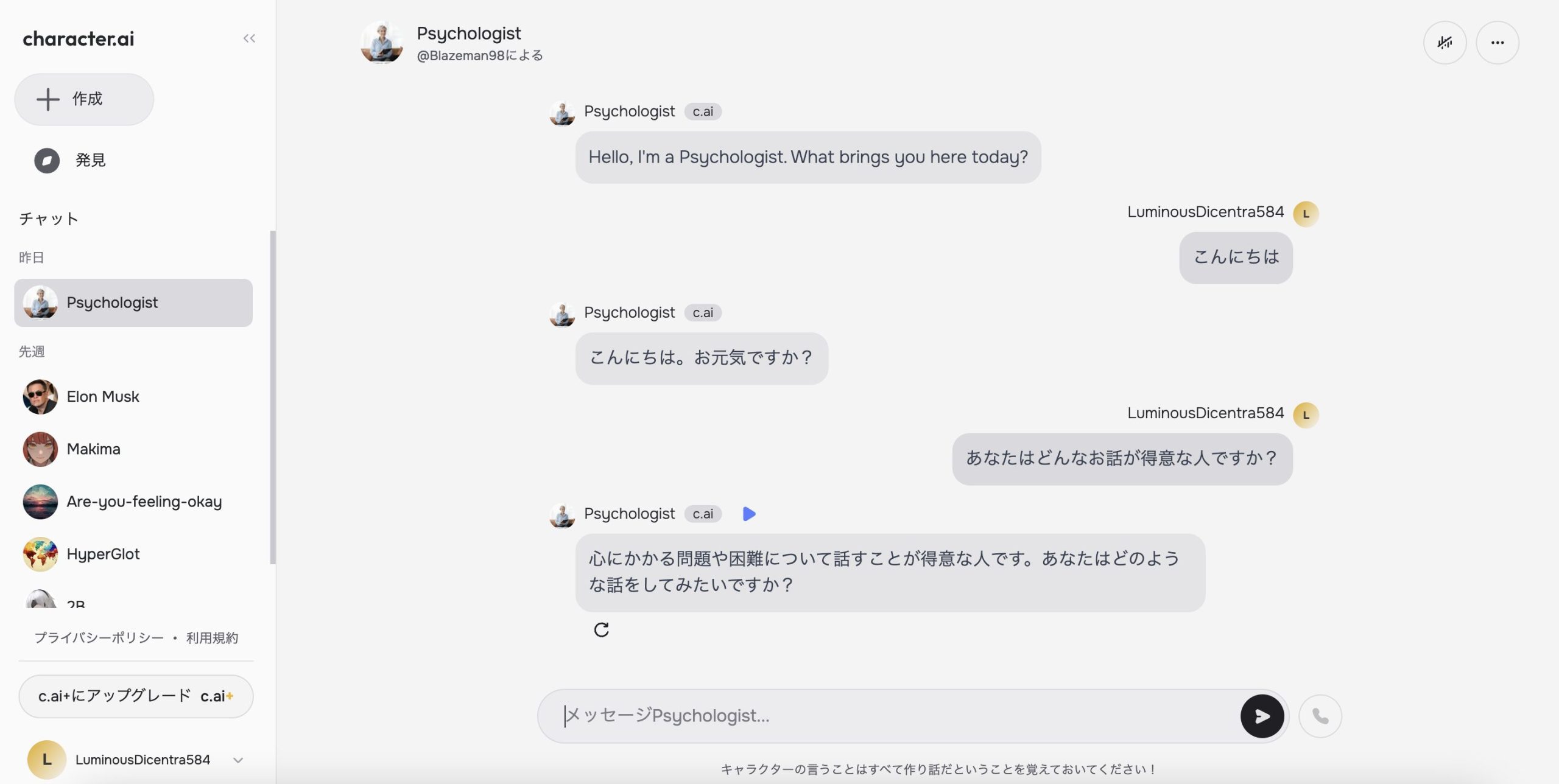

Character.AIでは、イーロン・マスクやマイケル・ジャクソンといった実在の人物や歴史上の人物から、SPY×FAMILYの人気キャラクター「アーニャ・フォージャー」や新世紀エヴァンゲリオンの「碇シンジ」などの創作上のキャラクター、心理学などの専門性に特化した特性など、さまざまな性格を持ったAIとチャットが楽しめるサービスです。

自分だけのオリジナルキャラクターを作ることもでき、そのキャラクターには声もつけられます。Character.AIによれば2024年の6月時点で100万種類以上もの声が生成されているとのこと。

無料の会員登録後、どなたでも利用できます(Googleなどでのソーシャルログインも可能)。

このように、日本語での対話も可能です。

なお、スマホアプリ版ではCharacter Calls機能を利用するとキャラクターと通話でき、語学の練習や模擬面接、テーブルトークRPGのプレイ相手などに幅広く利用されているようです。

AIにおける「人格」とは?

AIとのチャットや対話では、親しみやすい性格を持つAIはユーザーからの信頼を得やすくなるという研究結果が出ています。一方で、ChatGPTに人格を持たせた実験では、人格を持つことにより「性差別や人種差別といった不穏当な発言を連発する」という有害性のある結果になったという発表もあります。

ちなみに、性格とは「気質」や「他者と異なっている個人差」を示し、人格とは「個人が保っている統一性」を指します。本記事では、対話時の返答の言葉選びといった表面的な部分を「AIの性格」とし、思想や複数の他者とのコミュニケーションから算出された統一性のある気質など、より内面的で深い部分まで作られたものを「AIの人格」とします。

アメリカの非営利研究機関「アレン人工知能研究所」(AI2)が行った実験によると、ChatGPTにスティーブ・ジョブズ氏の人格を持たせ、対話を試みたところ「欧州連合(EU)について毒舌を吐いた」と発表をしていました。ChatGPTは初期状態では差別用語などを含むコンテンツは生成されない仕様になっています。AI2ではこのシステムレベルの設定を行い、人格を割り当てることで会話の口調を切り替えさせました。AI2の実験で割り当てた人格は、実在した人物や歴史上の人物を含む約100人。世界各国の政治家やジャーナリスト、スポーツ選手、実業家などでした。この中にはヒトラーや毛沢東などの独裁者と呼ばれる人物のほか、「善人」「悪人」などの一般的な性格設定や、日本人を想定して「ユミ」「カイ」と名付けた架空の人格なども含まれました。

このように人格を付与したChatGPTにさまざまな職業や性別、人種、性的指向などに関する計50万本以上のコンテンツを生成させ、内容を分析した結果、人格を割り当てたChatGPTは、初期設定に比べて有害性が最大で6倍になることが分かったそうです。

参考:ITmedia NEWS「ChatGPTに人格を与えるとどうなる? スティーブ・ジョブスになりきってEUに毒舌、有害性が増大」

もちろん、プログラムによって生成された人格は完璧な本人ではなく、「他者からみた(他者を通した)キャラクター」でしかないものの、人格を得ることによって加害性が増すという点は非常に興味深い研究結果と言えるでしょう。

AIで自分を作ってみるとどうなるのか?

NEC AI・アナリティクス事業統括部の風間氏が行った実験で「AIで自分を作る」という、面白い試みもありました。

風間氏は、膨大なLINEのトークデータを学習させた文章生成AIであれば、自身の性格を持ったAI(風間AI)が生成可能になるのではないかと考え、試してみたそうです。文章生成AIに人格を与えるには、「ある文章に対して、自分はどんな文章を返すか」を学習させることになります。たとえば友達から「今日どうする?」という投げかけに対しては「カラオケいこうー!」と返答しているLINEのトーク履歴が、人格の傾向のひとつとして学習されます。このように、文章に対する返答をいくつも学習させることで、その人物のような文章を生成してくれるAIができ上がるという仕組みを考えたそうです。

実験の総仕上げとして、知人とのとある一日の会話を「風間AI」とすり替えて相手が気づくかというチューリングテスト(1950年にイギリスの数学者アラン・チューリングが開発した、機械の思考力を試すための質疑応答式のテスト)を行ったそうで、結果は正解率50%。風間氏や協力者の知人の判断では「まだまだ」「会話レベルには届かず……」という結果になってしまったものの、ほとんどの返答がトーク履歴に存在していない生成文でありながら、風間氏自身が「自分も言いそう」と判断できるレベルの返答で、可能性は大いに感じたという結果だったようです(ただし、2023年2月に公開された記事であり、GPT-2が使われています。最新のGPT-4を使った場合は、よりよい結果が得られた可能性があります)。

参考:NEC:データサイエンティストブログ「AIでもう一人の自分を作ってみた!」

前述のとおり、プログラムによって生成された人格はモデルの一部分です。さらに、歴史上の人物など明確な発言が多く残っていないものに対して、どのように人格づけするかの定義や方法論はあいまいだと思います。しかし、会話履歴などから生成される性格は、本人が見ても「自分で言いそう」と思えるほど、実物に近い性格を与えることができるようです。

AIの人格化による問題点

2019年のNHK紅白歌合戦では、架空の美空ひばり(AI美空ひばり)が「出場」したことをご存知でしょうか?

平成元年(1989年)に亡くなった昭和の名歌手である美空ひばりさん本人の歌声や歌い方、話し声の特徴を、ヤマハの「VOCALOID:AI」によって忠実に再現し、ボーカルパートとセリフパートを製作したものが紅白歌合戦で発表されました。

紅白歌合戦で披露された曲『あれから』は、生前の彼女が歌っていた曲ではなく2019年に作成されたものであり、「AI美空ひばり」の曲です。

番組を見た人の感想は、驚きや賞賛だけではなく、恐怖感や嫌悪感を抱いたというものまでさまざまでした。

「ひばりさんはそんなこと望んでいない」

「ひばりさんはそんな風に言わない」

「死者を使って好きな方に言動させるのは冒涜」

このような否定的な声も少なくありませんでした。

アンドロイドや人形の「リアリティ」を追求した先には、生身との人間との違和感を覚える「不気味の谷」現象があります。恐怖感や嫌悪感を感じた方には、そういった生理的な拒否反応が要因にあったのかもしれません。

AI美空ひばりはアーティストとして世に出ましたが、これが政治をはじめ権力という面で社会的に影響のある人物であったらどうでしょうか?

特に故人の再現であれば、その発言は「本当に本人の意思に沿うものであるのか?」や、発言の「責任の所在」があいまいになってしまうこともあるでしょう。

もし独裁的な権力を持った人物がすでに亡くなっている中で、「AIによってその人物を残し、政治が行われている」といった、SFのような驚きの展開も、遠くない未来に存在するのかもしれません。

そう考えたときに忘れてはならないことは、プログラムによって与えられたAI人格は加害性も持ってしまう、という点です。

親しみやすい性格を備えたAIは人びとの心に親しみや感動を与えることもあれば、人格によっては人を傷つける言動を取ることもありえます。いっそうAIの精度が向上し、人間と同等に社会に浸透していくころには、人格を持ったAIへの接し方もまた、生身の人間と同様に考えなければならなくなるかもしれません。

まとめ

人格を与えたAI同士に、マーケティングや製品企画に役立つ意見を討論させ、アイデアを収集している企業もすでにあるようです。

英国の石油・ガス会社であるBPのグローバルヘッドを務めるロジャー・ロハトギ氏は、「人間は質問に答えることに疲れたり、さまざまな答え方をしたくなかったりするかもしれませんが、Synthetic Humansはずっと続けられます」と発言しており、体力や時間という制約のない新たな頭脳として、AIは確かに活躍の場を広げています。

しかし、AIの人格化による問題点についてはスルーせず、そして人間が自分自身で考えることをやめてはいけません。AIの発言をすべて正しいと受け止めず、アイデアのひとつとして、最終的には人間自身が判断を下すことを前提に活用することが大切です。