日本時間で6月11日から開催されているAppleの開発者向けカンファレンス WWDC 2024 の初日(Day 1)では、iPhone、iPad、macOSで利用できる人工知能(AI)機能が発表されました(1時間6分くらいから)。

ChatGPTや画像生成AIなど、さまざまなAIが一般化してきた中で、Appleは「デバイスをよりパーソナルで便利なものへ」という理念のもと、独自の生成AI(=Apple Intelligence)を発表しました。

一般的なAIとはArtificial Intelligence(人工的な知能)の略であるのに対し、AppleはApple Intelligence(Apple社の知能)と命名していますが、機械学習によって使うほどに便利になっていくという大まかな方向性は同じのようです。

Apple Intelligenceによって、Siriがより口語的な指示を理解できるようになったり、「私と母の写真だけ表示して」といった複雑な指示を理解できるようになるなど、飛躍的な進化が期待できるとのこと。

- 利用できるデバイスはどれなのか?

- 利用可能はいつから?

- 発表されたApple Intelligenceは、他のAIとどう異なるのか?

- iOSデバイスはAIの搭載で、どのように便利になるのか?

などなど、WWDC2024基調講演で発表された内容をご紹介します。

新AIは、いつからどのデバイスで利用できるの?

残念ながら、すべてのデバイスですぐに利用できるわけではないようです。

対応するデバイスは以下の通りです。

- iPhone:A17 Proチップ搭載機種

iPhone 15 Pro/iPhone 15 Pro Max - iPad:M1チップ以降

iPad Pro/iPad Air - macOS:M1チップ以降

Apple Silicon搭載Macであれば利用可能

利用できる時期は、米国で2024年秋にiOS 18、iPadOS 18、macOS Sequoiaの一部としてベータ版の提供を開始。英語以外の言語への対応は2025年を予定しているようです。

iPhoneの対応機種は15 Pro以降ですが、2024年の秋に出るであろうiPhone16シリーズでも対応するのは間違いありません。日本語対応はまだ先ですが、気になる方は「A17 Proチップ」が搭載されているモデルの購入がおすすめです。

セキュリティを考慮し、デバイス完結処理を実現

現在一般流通している機械学習機能の多くは、データをサーバーに送信することによって演算処理を行うため、セキュリティやプライバシー、知的財産などの問題点が懸念されていました。

しかし、AppleのAIでは「基本的にはデバイスで演算を完結させ、データを外に出さない」とのこと。AIの欠点ともされていた問題をクリアしている点が大きな違いとして挙げられるでしょう。

「Apple Intelligenceがデバイス上での処理が可能か判断して、さらに大きな演算能力が必要な場合はタスクに関連するデータのみをサーバーに送信する」としています。サーバーに送信した場合にも「Appleがユーザーのデータを保存したり、データにアクセスすることは絶対に行わない」と、セキュリティの面でも個人に寄り添った機能だと発表されていました。

スマートフォンは、いまや家族や恋人以上に利用者のことを知り尽くしており、iPhone内のデータはとてもセンシティブなものです。利用者の秘密を漏らすことなく、人間の執事や相棒とも呼べるくらいに複雑なお願いを理解し寄り添ってくれるということで、いっそう期待が高まるのではないでしょうか?

日常生活で便利になること

AppleのAIでは、自然な言語を理解し、写真や画像を人間に近い感覚でピックアップすることもできるようです。

たとえば、「お母さんと私が写っている写真を全部見せて」「この前撮影した子供の写真を夫へ送って」「画像の住所を登録して」など、複雑な指示もSiriが理解し実行してくれるようになるとのこと。

1. 言語学習によって便利になること

自然な言語を理解できるようになるため、Siriの音声アシスタントとしての機能が向上します。

Siriをはじめ音声アシスタントに指示するには、コツが必要でした。

筆者の母も質問に対してしばしば「すみません、何を言っているのかわかりません」と返答され、「Siriのバカ」と叱っている様子が見られました。

しかし、新しいAIでは、多少の言い間違いや曖昧な表現でも理解できるようです。また、Siriが前の会話を覚えるようになるため、「土曜日の横浜の天気を教えて」「そこで9時からハイキングの予定」など、続けて依頼できるようになるとのことです。

さらに、何かを実行したいけれど機能がわからないときにも、「今メッセージを書いて明日送るにはどうする?」といった質問をすると、Siriが返答してくれるようになります。

よりフレキシブルに利用できるようになるSiriなら、スマートフォンなどのデバイスや音声アシスタントの利用に不慣れな方でもより利用しやすくなるのではないかと思います。

画像:Apple WWDC 2024 — June 10 | Apple

また、「書き直し」と呼ばれる文章校正ツールも追加されるようです。

このツールは、テキストとして入力した文章の文法や単語の正確性チェックだけにとどまらず、文章の要約やユーモアをもった言い回しの提案まで行ってくれるとのこと。

メール、Safari、メモ、Keynoteといった定番のアプリから他社製のアプリにいたるまで、いつでも利用できるようになるので、私たちが運営しているこのVoista Mediaも、AIの監督下で記事を作成する日が来るかもしれません。

要約機能は電話での会話にも利用できるようになるようです。電話アプリから録音を行い、メモアプリのように文字を起こし、内容の要約までできるようになります。電話アプリの録音時には、録音を始める旨が相手へ通知されるしくみになっており、ビジネスの場だけでなく、日常生活での契約関係など複雑な内容の録音、果ては怪しい電話への犯罪抑止にもつながるのではないかと期待が高まります。

2. 画像学習によって便利になること

画像学習の側面では、「写真」アプリには編集機能が追加され、写真をより細かく補正したり、人や物体を消したりできるようになります。すでにGoogleの「Pixel」やサムスンの「Galaxy」に搭載されている機能ではありますが、画像編集にもSiriが有効で「この画像を明るして」といった音声指示もできるようです。

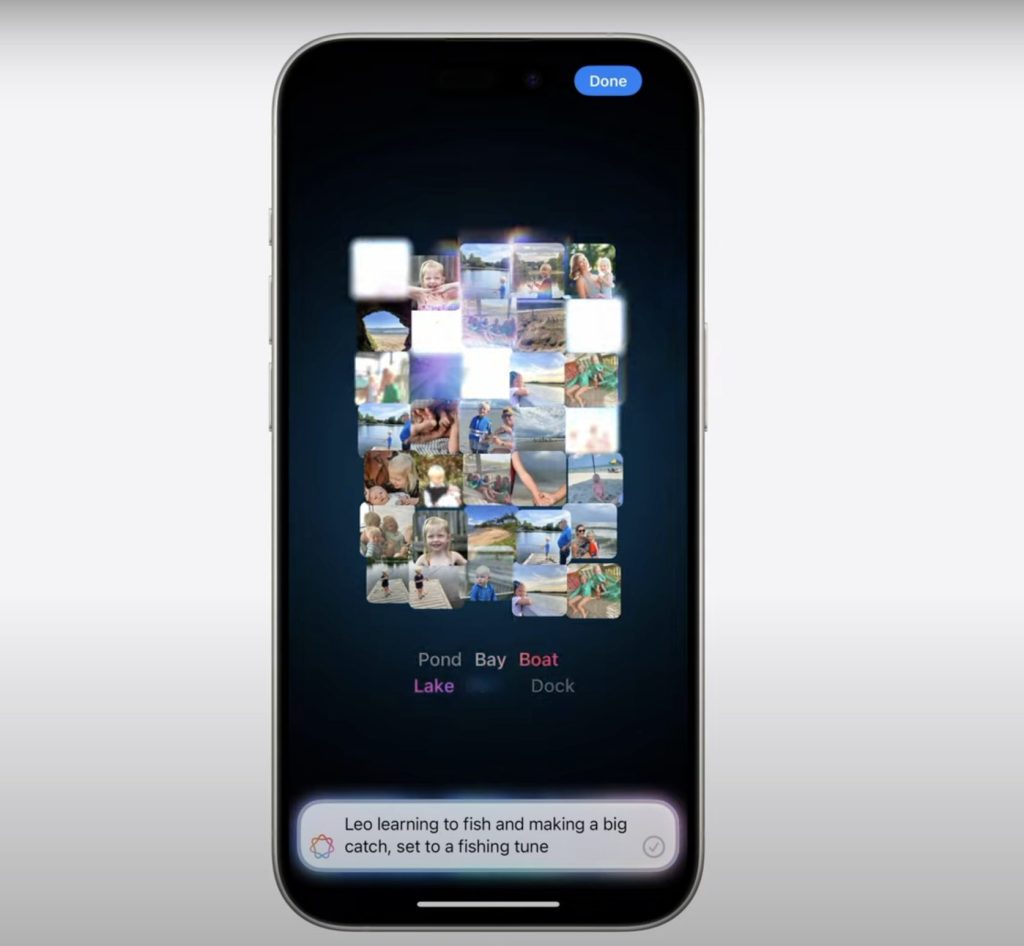

また、連絡先の人物を認識して写真を見つけやすいようにグループ化できるため、「釣りを勉強中のレオの写真を探して」といった具合に、より自然な言葉で写真を探せるようになります。

画像:Apple WWDC 2024 — June 10 | Apple

3. その他の便利機能

さらに、気が散るものを最小限に抑え、仕事やパーソナルな連絡など重要な通知を優先して表示する機能が充実するようです。

現在の「集中」「仕事」「睡眠」モードの際にもアプリの通知が制限されますが、さらに個人が利用しているアプリケーションの中から重要度を判別して表示させるのではないかと思います。

また、オリジナルの絵文字の作成も可能になり、画像学習と掛け合わせて、撮影した顔写真から似顔絵をアイコンやイラストとして作成することもできるようです。

まとめ

いかがだったでしょうか?

日本でのスマートフォンのシェアはiPhoneが約50%を占めているというデータがあります。老若男女が利用しており、機種の買い替えやデータの移管が簡単だから利用しているというスマホライトユーザーも多いでしょう。

Appleの新しいAIは、英語以外の言語での利用は2025年となることや、比較的新しいデバイスでないと利用できないという制限はありますが、いっそう手軽に利用できるようになれば、Appleデバイスがまるで執事ロボのように自分をアシストしてくれる、という未来も遠くないのかもしれません。

Voista Mediaでは、声、音声、録音、声に関するテクノロジーなどの情報を週に一度お届けしています。

声に関するライフハックやビジネスハックから、ハラスメントへの対抗手段まで、幅広くご紹介しています。

気になった方はぜひ他の記事も読んでみてくださいね。